轻量AI新力量崛起;GPT-5.4mini与nano问世,编程与多模态任务迎来变革。

OpenAI近日重磅更新产品线,正式推出GPT-5.4mini以及GPT-5.4nano两款轻量级大语言模型。这一系列动作延续了公司对高效AI解决方案的持续探索,旨在为开发者与企业用户提供性能强劲却资源友好的选择。这些模型针对快速迭代、高并发的工作负载进行了深度优化,标志着AI技术从追求单纯规模转向平衡能力与实用性的新趋势。

当今AI应用生态中,许多场景对响应时延极为敏感,一旦延迟增加,用户体验便会明显下降。OpenAI明确指出,新模型特别适用于编程助手、子智能体协作、屏幕内容实时解析以及图像驱动的多模态推理等需求。在这些领域,模型的响应速度、工具调用可靠性以及在垂直任务上的稳定表现,往往比单纯的参数量更具决定性意义。开发者们越来越倾向于采用混合架构:让旗舰模型处理高难度规划,而将执行层交给更敏捷的轻量模型。

GPT-5.4mini在多个核心维度实现了全面升级,包括代码生成、复杂推理、多模态内容处理以及外部工具集成。其整体运行效率较前代有大幅提升,能够在更短时间内输出高质量结果。相比之下,GPT-5.4nano定位更为专注,体积更精简、速度更快,适合执行分类整理、关键信息抽取、优先级排序以及基础代码辅助等相对简单的子任务。这种梯度化的产品布局,让用户可以根据实际需求灵活搭配模型组合。

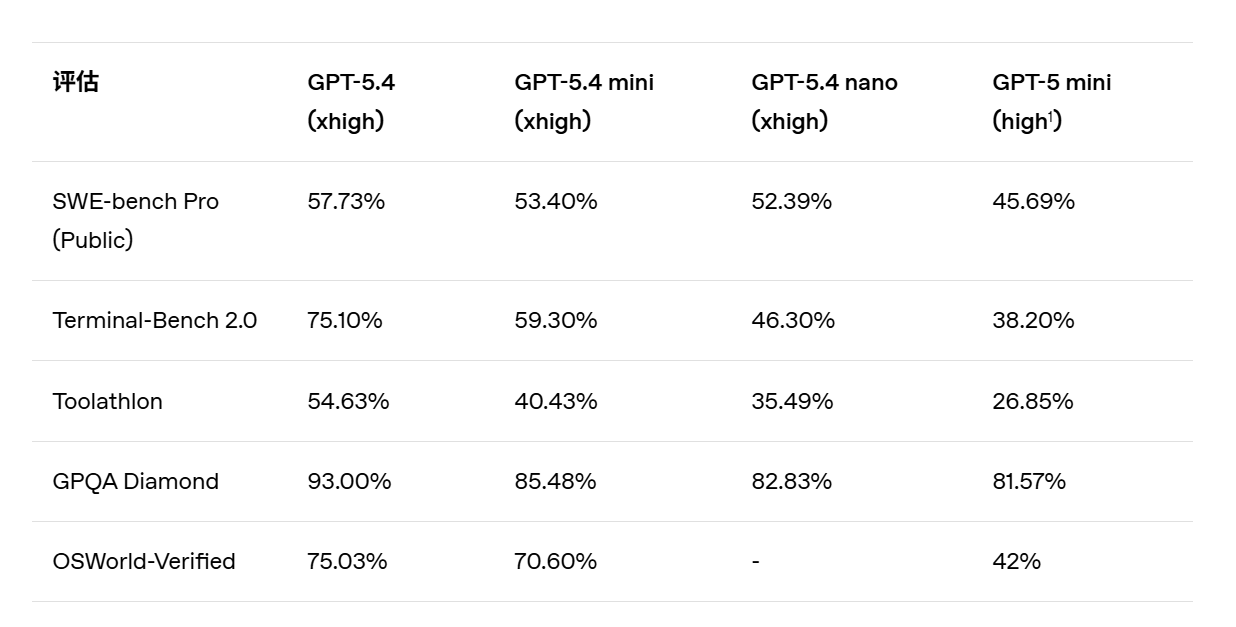

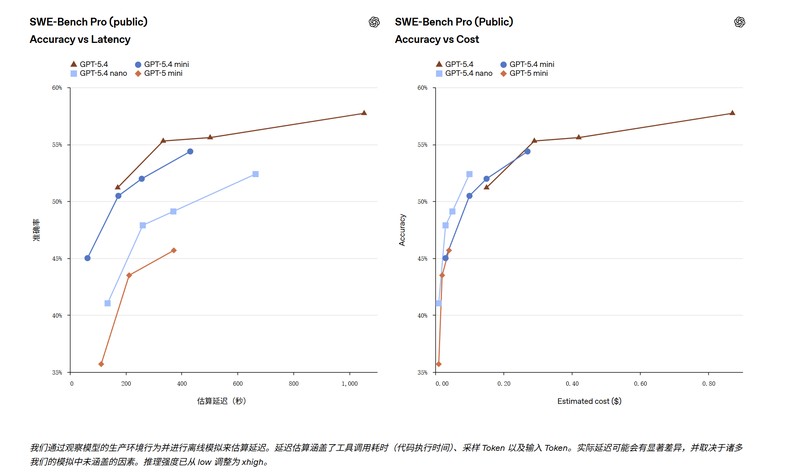

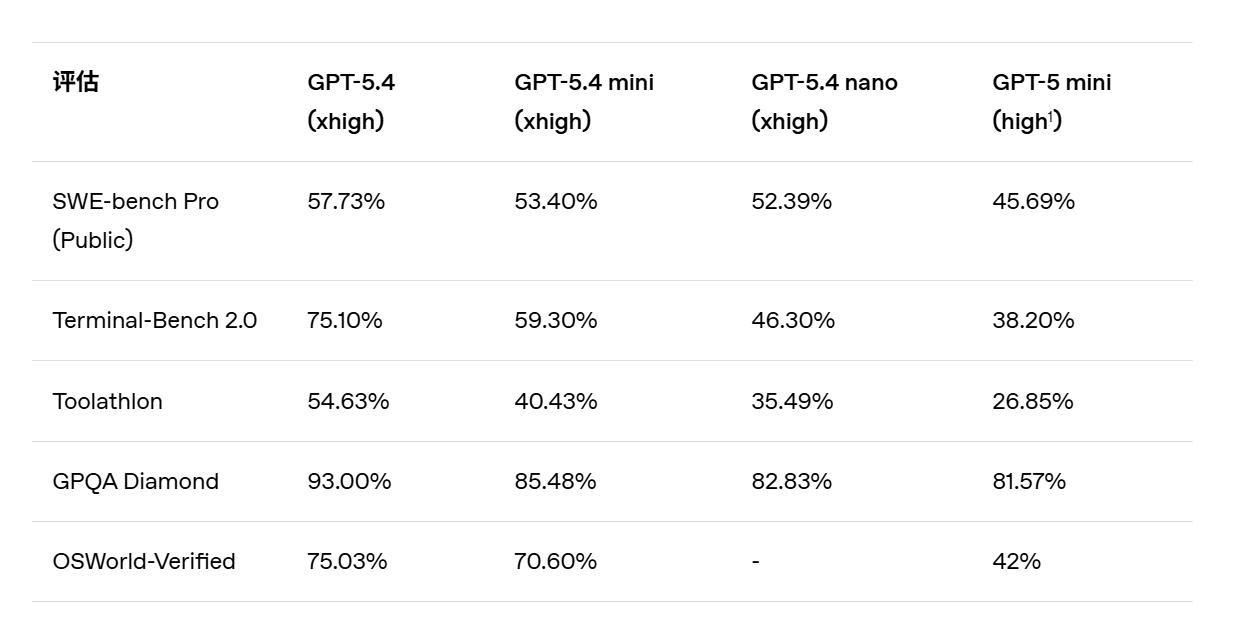

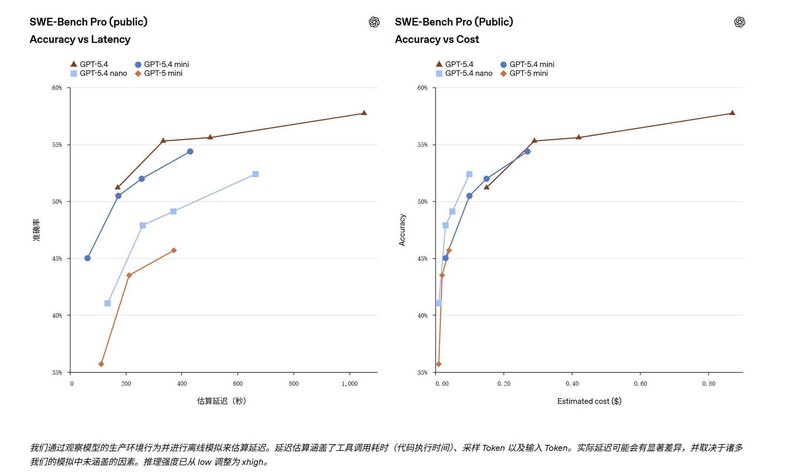

多项权威基准测试充分展示了这些新模型的竞争力。在编程相关的SWE-benchPro评估中,mini版本得分明显领先旧款;在终端操作Terminal-Bench2.0中,也取得了显著进步。GPQADiamond这类高阶推理测试显示,其表现已逼近更大规模的旗舰型号。OSWorld-Verified基准进一步证实,轻量模型在模拟真实计算机使用场景时,已具备相当接近全功能版的解决能力。这些结果突显出,通过精巧设计,轻量模型能够在专业领域实现高效赶超。

智能体框架的兴起为这类模型提供了广阔舞台。在多代理协作体系中,大模型充当大脑,负责战略分解与监督;mini与nano则如同高效执行者,承担具体操作。这种分工类似于软件工程中的资深与初级工程师配合,能够最大化整体系统吞吐量。GPT-5.4mini的多模态能力尤为突出,它能直接解读复杂UI截图,从而支持自动化操作流程。这为构建更智能的桌面助手、自动化工作流等应用打开了新可能性。

从可用性角度看,GPT-5.4mini已全面接入OpenAI生态,包括API接口、Codex编程环境以及ChatGPT对话平台。免费与基础用户可通过便捷入口调用;高级用户则可在触发限制后无缝切换至该模型。对于编程群体,Codex已深度集成mini支持,开发者能够以更低的资源代价处理日常编码需求。同时,系统支持任务智能分发,让简单部分自动路由至低成本子模型,进一步提升经济性。nano版本则专供API使用,适合追求极致性价比的批量部署场景。

行业用户反馈同样积极。Hebbia公司在文档智能处理领域测试后认为,mini模型在整体稳定性、引用准确性以及端到端表现上均达到高水准,资源效率明显优于更大模型。Notion团队则强调,该模型在结构化内容编辑任务中精度突出,格式处理能力强劲,却显著降低了计算负担。这些真实案例表明,新模型不仅停留在实验室数据层面,更已在商业生产环境中展现出可靠价值。

展望未来,GPT-5.4mini与nano的发布无疑加速了AI民主化进程。它们让高性能AI能力触手可及,推动更多中小团队与个人开发者参与创新。通过持续的效率迭代,AI将从昂贵实验工具逐步转变为日常基础设施。这场变革将重塑软件开发、生产力工具乃至整个数字经济格局,为人类创造更大价值。